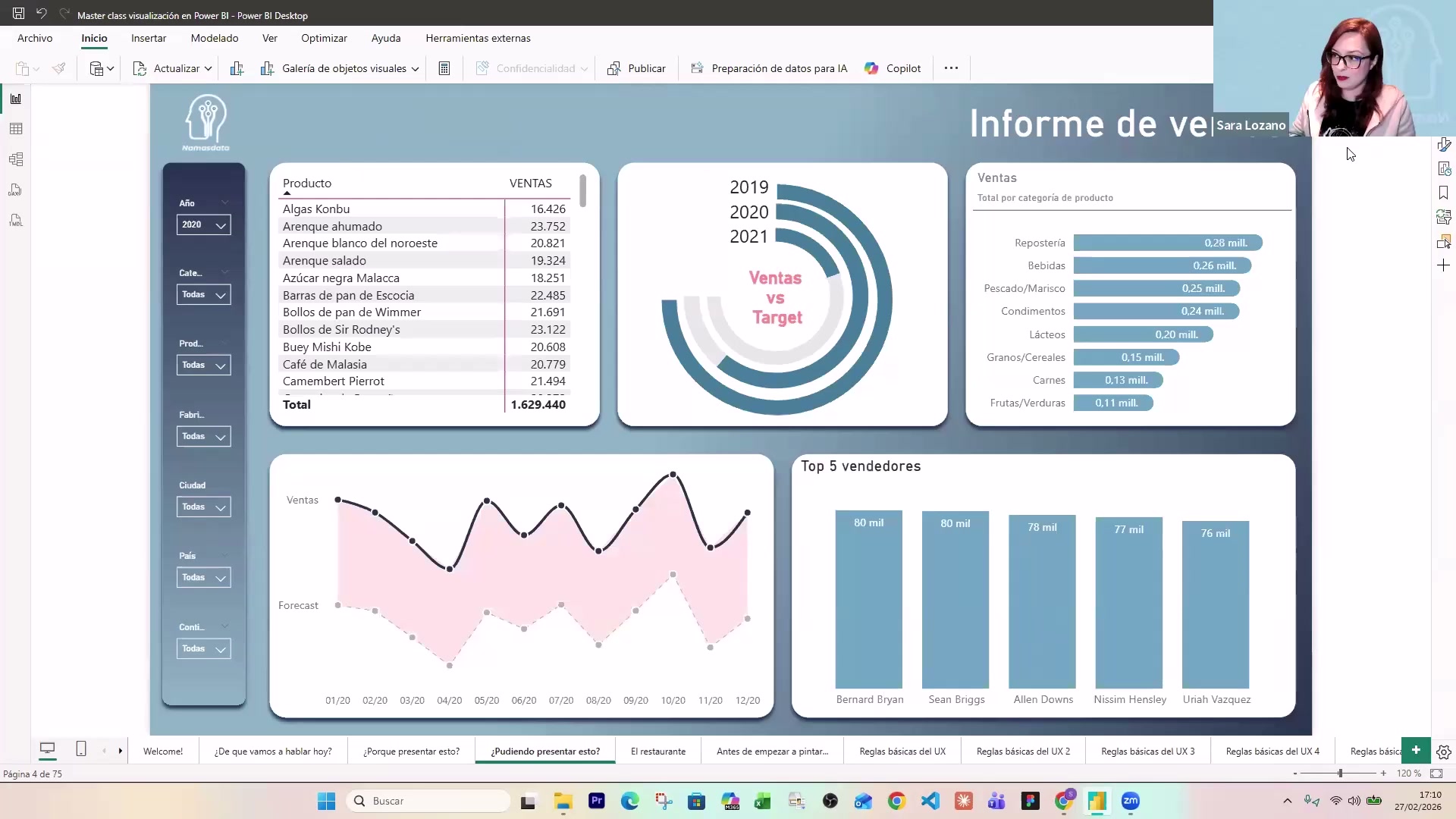

Una de las habilidades más infravaloradas —pero tremendamente efectivas— para mejorar el rendimiento en Power BI es saber cuándo y cómo reducir el tamaño del modelo de datos. Y no se trata solo de eliminar columnas innecesarias. A veces, el cambio más potente consiste en modificar el nivel de granularidad de la información. Esta decisión estratégica puede marcar la diferencia entre un informe lento y pesado y uno ágil, confiable y escalable.

En este artículo abordaremos dos estrategias complementarias para optimizar tus modelos:

- La agregación de datos para reducir filas sin perder valor analítico.

- El uso de herramientas de diagnóstico para entender el coste real de cada transformación en Power Query.

Ambas prácticas son clave cuando trabajamos con modelos grandes o cuando deseamos mejorar la experiencia de usuario reduciendo los tiempos de espera y los errores por exceso de datos.

¿De verdad necesitas tanto detalle?

Imagina un almacén de datos que contiene información de ventas e inventario con un nivel de detalle diario. Si tienes registros por día, producto, tienda y cliente durante varios años, estarás acumulando millones de filas. Y lo más probable es que la mayoría de tus informes solo necesiten datos agregados por mes. Mantener el detalle innecesario no solo perjudica el rendimiento, sino que también complica el mantenimiento del modelo y su comprensión.

Reducir el detalle cuando no se necesita permite:

- Acelerar los tiempos de carga y visualización.

- Reducir el consumo de memoria y recursos.

- Simplificar el modelo de datos.

- Minimizar riesgos de errores en cálculos DAX complejos.

Veamos un ejemplo sencillo: supón que tienes una tabla con 10 registros de ventas diarios. Si tu objetivo es analizar ventas mensuales, puedes agrupar por mes y quedarte solo con 4 registros. Sí, se pierde algo de granularidad, pero el modelo será mucho más eficiente si no necesitas consultar el dato diario.

Este principio se puede aplicar a cualquier escenario: reemplazar millones de registros por una tabla con cientos de filas agregadas puede cambiar por completo el rendimiento de tu informe. Y lo mejor es que este tipo de transformaciones pueden implementarse desde el inicio del proyecto o durante un rediseño del modelo existente.

Cuándo y cómo usar agregaciones

No se trata de resumir siempre, sino de hacerlo de forma estratégica. Algunas recomendaciones:

- Identifica los informes que no requieren granularidad completa. Por ejemplo, informes ejecutivos o KPIs de seguimiento mensual.

- Agrupa por las dimensiones temporales clave: año, mes, trimestre.

- Calcula solo las métricas necesarias: ventas totales, unidades vendidas, margen bruto, etc.

- Hazlo en el origen si puedes (vistas SQL, procedimientos almacenados, etc.), o en Power Query si no tienes acceso al servidor.

También es recomendable:

- Evitar duplicar los datos. Si generas una tabla agregada, asegúrate de no mantener la tabla detallada si no se utiliza.

- Documentar claramente la lógica de agregación para que otros usuarios comprendan el propósito del resumen.

- Testear el impacto del cambio en medidas DAX y relaciones.

Usar agregaciones correctamente es una de las formas más directas y efectivas de mejorar el rendimiento sin necesidad de tocar DAX. Además, esta práctica fomenta modelos más sostenibles a largo plazo y facilita la colaboración entre equipos.

Herramienta clave: diagnóstico de consultas en Power Query

Optimizar sin medir es como pilotar sin instrumentos. Ahí es donde entra la herramienta de diagnóstico de consultas, disponible en Power Query. Esta utilidad te permite ver exactamente qué operaciones se están ejecutando, cuánto tiempo consumen y qué recursos implican.

No solo se trata de detectar qué pasos tardan más, sino de entender por qué ocurre y tomar decisiones informadas: ¿estamos esperando a un servidor lento? ¿Hay pasos redundantes? ¿Hemos colocado mal el orden de las transformaciones?

¿Qué puedes diagnosticar?

Hay dos modos:

- Diagnóstico de sesión: registra todas las operaciones mientras realizas pasos en Power Query.

- Diagnóstico de paso: analiza una transformación concreta dentro de una consulta.

Ambos generan tablas internas con resultados muy valiosos:

- Counters: consumo de CPU y memoria.

- Detailed: operaciones paso a paso con duración exacta.

- Aggregated: resumen legible de las operaciones.

- Partitions: detalles sobre las particiones lógicas y privacidad.

Una vez generadas, puedes activar la opción «Habilitar carga» para analizar estas tablas dentro del propio informe. Incluso puedes exportarlas para su análisis posterior en Excel u otras herramientas de diagnóstico.

¿Qué columnas observar?

Algunas columnas especialmente útiles son:

- query: identifica la consulta afectada.

- operation: muestra si se trata de una conexión, una lectura, una evaluación, etc.

- start time y end time: marcas temporales.

- exclusive duration: tiempo consumido solo por esa operación.

Gracias a esta información puedes detectar cuellos de botella, como pasos que tardan mucho por culpa de un origen lento o de una transformación ineficiente. También podrás diferenciar entre operaciones locales y aquellas que dependen de servicios externos, lo cual es crucial para entornos con múltiples fuentes conectadas.

Mejora continua basada en evidencias

Una vez tengas esta información, puedes:

- Evitar pasos duplicados o innecesarios.

- Reordenar transformaciones para que las más costosas se ejecuten lo más tarde posible.

- Mover cálculos al origen de datos si Power Query está esperando demasiado.

- Replantear tu modelo si descubres que algunas consultas están cargando datos que no se usan.

Además, contar con diagnósticos documentados permite compartir mejoras con otros equipos, justificar decisiones técnicas y prever el impacto de nuevas fuentes o cambios en la estructura de datos.

Si trabajas en proyectos colaborativos o modelos compartidos en entornos organizativos complejos, estas evidencias también te ayudarán a establecer acuerdos sobre cómo estructurar y mantener los modelos.

Conclusión

Optimizar modelos de Power BI no consiste en hacer magia con DAX. A menudo, los mayores avances vienen de decisiones sencillas como:

- Reducir filas mediante agregaciones.

- Eliminar columnas inútiles.

- Analizar el coste de cada transformación con herramientas como el diagnóstico de consultas.

Estas prácticas son especialmente útiles si trabajas con grandes volúmenes de datos, múltiples orígenes o informes compartidos en la organización. A veces, un modelo más pequeño es un modelo más potente. Además, cuanto más limpio y ágil sea tu modelo, más fácil será mantenerlo, escalarlo o migrarlo a nuevos entornos.

📌 Si quieres profundizar en estas estrategias, te recomiendo este curso: https://www.cursopl300.com

¿Y tú?

¿Has usado alguna vez la herramienta de diagnóstico de Power Query?

¿Dónde crees que podrías aplicar agregaciones en tus propios informes?

¿Te has encontrado con modelos que funcionaban mal y luego descubriste que solo necesitaban un poco de limpieza?

Cuéntamelo en los comentarios, o visita www.formacionbi.com si quieres leer más sobre optimización y buenas prácticas en Power BI.

Deja un comentario