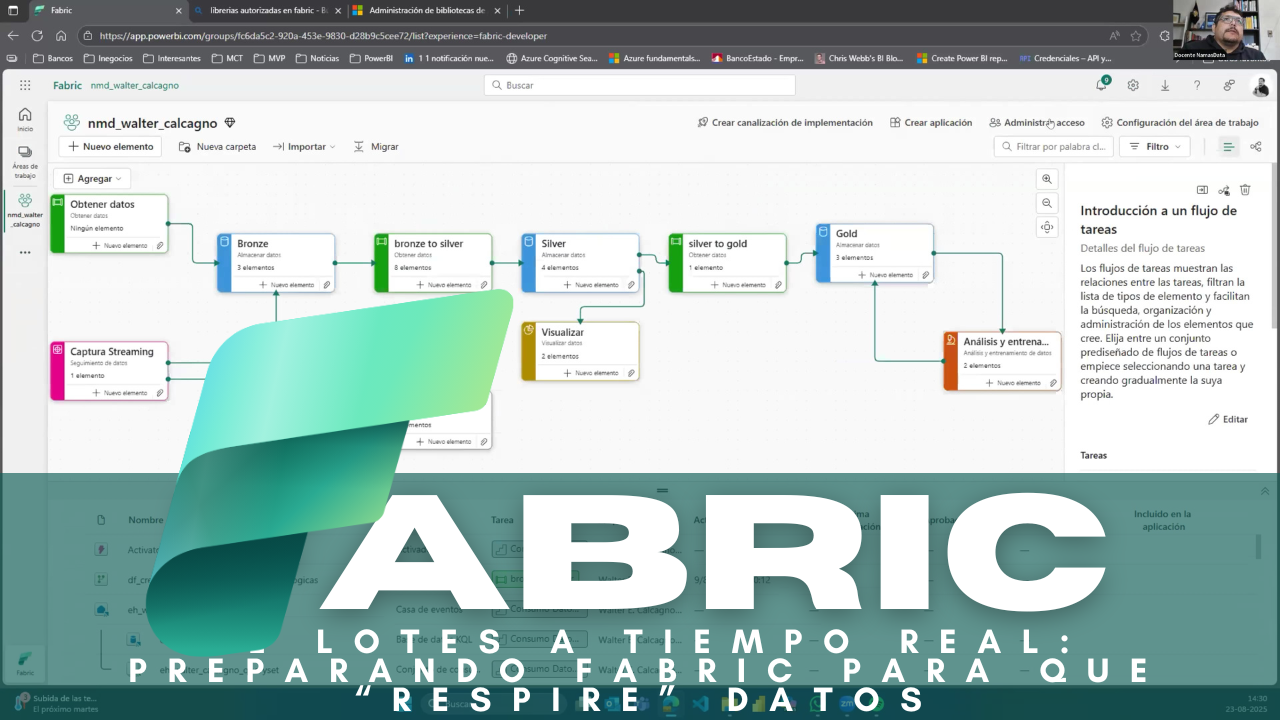

En la quinta sesión del curso de Fabric, hemos profundizado en el uso de Microsoft Fabric, impartido por Walter Calcagno Lucares en NamasData

dimos un paso decisivo. Hasta ahora, habíamos trabajado con la lógica por lotes: ir a buscar los datos, procesarlos, transformarlos y dejarlos listos para análisis. Pero en esta sesión cambiamos radicalmente el enfoque: los datos ya no esperan a que los busques. Llegan cuando ocurren. Respiran. Y tu sistema debe estar preparado para escucharlos.

Este cambio no es un matiz técnico, es un salto conceptual. Supone repensar arquitecturas, diseñar con otras expectativas de latencia y construir procesos que no se activan porque alguien los programa, sino porque la realidad los desencadena. El objetivo del día fue precisamente ese: aprender a preparar Fabric para manejar datos en tiempo real, desde la captura hasta el consumo, pasando por la automatización, la seguridad y la supervisión.

El cambio mental: de lotes a transmisión

En batch, nosotros decidimos cuándo ir a por los datos. En streaming, la situación se invierte: debemos estar escuchando. Esto obliga a pensar distinto en cada capa de la arquitectura. Ya no se trata solo de cuánto tarda un proceso en completarse, sino de qué tan rápido reaccionamos cuando ocurre algo.

Es un enfoque que refleja lo que pasa en el mundo físico: un sensor que detecta temperatura, un sistema de pagos que recibe transacciones, un click en una web. Son eventos que no esperan tu ETL nocturna. Si tu arquitectura no está preparada, el valor se evapora.

Event Stream: la entrada al sistema

El primer paso fue configurar un Event Stream. No basta con abrir un canal; hay que definir con cuidado qué fuentes vas a escuchar, cómo mapear los campos y qué transformaciones aplicar para que los datos lleguen coherentes.

En este punto descubrimos que un detalle tan aparentemente simple como definir bien los tipos de dato marca la diferencia. Una fecha mal clasificada, un número tratado como texto o una columna innecesaria que se arrastra pueden bloquear la agilidad del sistema. Por eso, la normalización temprana no es un trámite, es el seguro de vida del flujo.

Dos caminos, dos velocidades: Lakehouse y Eventhouse

Con los datos ya canalizados, surge la pregunta: ¿dónde los guardamos? Aquí Fabric ofrece una decisión estratégica que vimos en la práctica: combinar Lakehouse y Eventhouse.

El Lakehouse es tu archivo histórico. Guarda todo lo que llega, sin prisas, para que puedas reconstruir contextos, trazar evoluciones largas o volver atrás en el tiempo. Es frío, barato y confiable.

El Eventhouse es tu mesa de operaciones en caliente. Aquí no interesa guardar, interesa consultar. Lenguaje KQL en mano, puedes filtrar, contar, agregar y obtener respuestas en segundos. Es el lugar donde sabes si la bolsa está subiendo ahora, si un sensor ha cruzado un umbral o si una transacción debe disparar una alerta.

La clave no está en elegir entre uno u otro, sino en usarlos juntos. El histórico para comprender, el caliente para reaccionar.

Consultar lo vivo: KQL como nuevo idioma

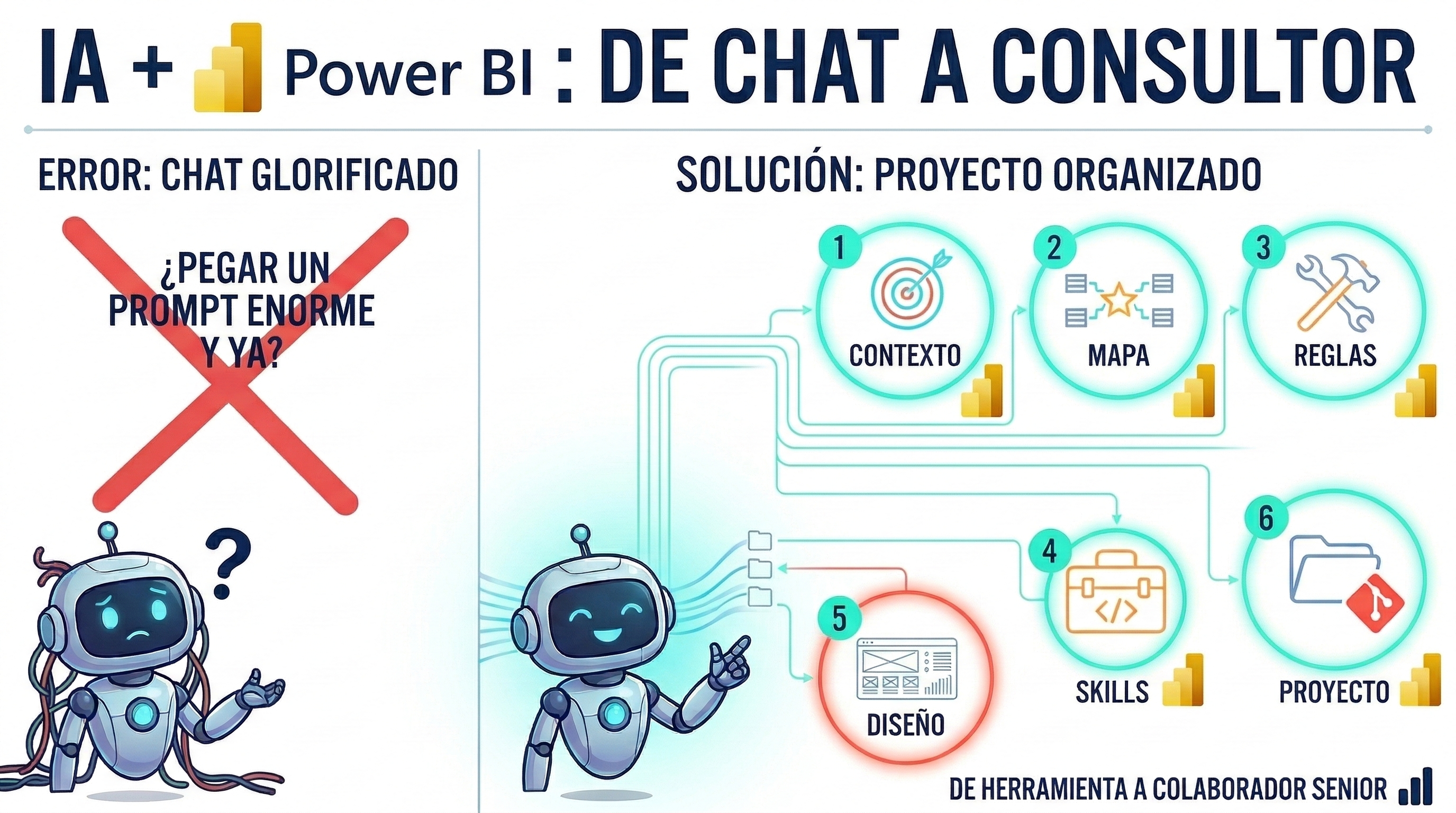

Muchos llegamos con mentalidad SQL, y eso ayuda, pero KQL (Kusto Query Language) nos obligó a pensar de otra manera. No es un reemplazo, es un dialecto diseñado para trabajar con series temporales y grandes volúmenes en movimiento.

Lo fascinante fue ver cómo, con pocas sentencias, puedes inspeccionar un flujo que respira. Ver en directo cuántos registros llegan en un intervalo, agrupar por símbolo bursátil o calcular promedios en ventanas de minutos. Es la diferencia entre mirar una foto y mirar una película.

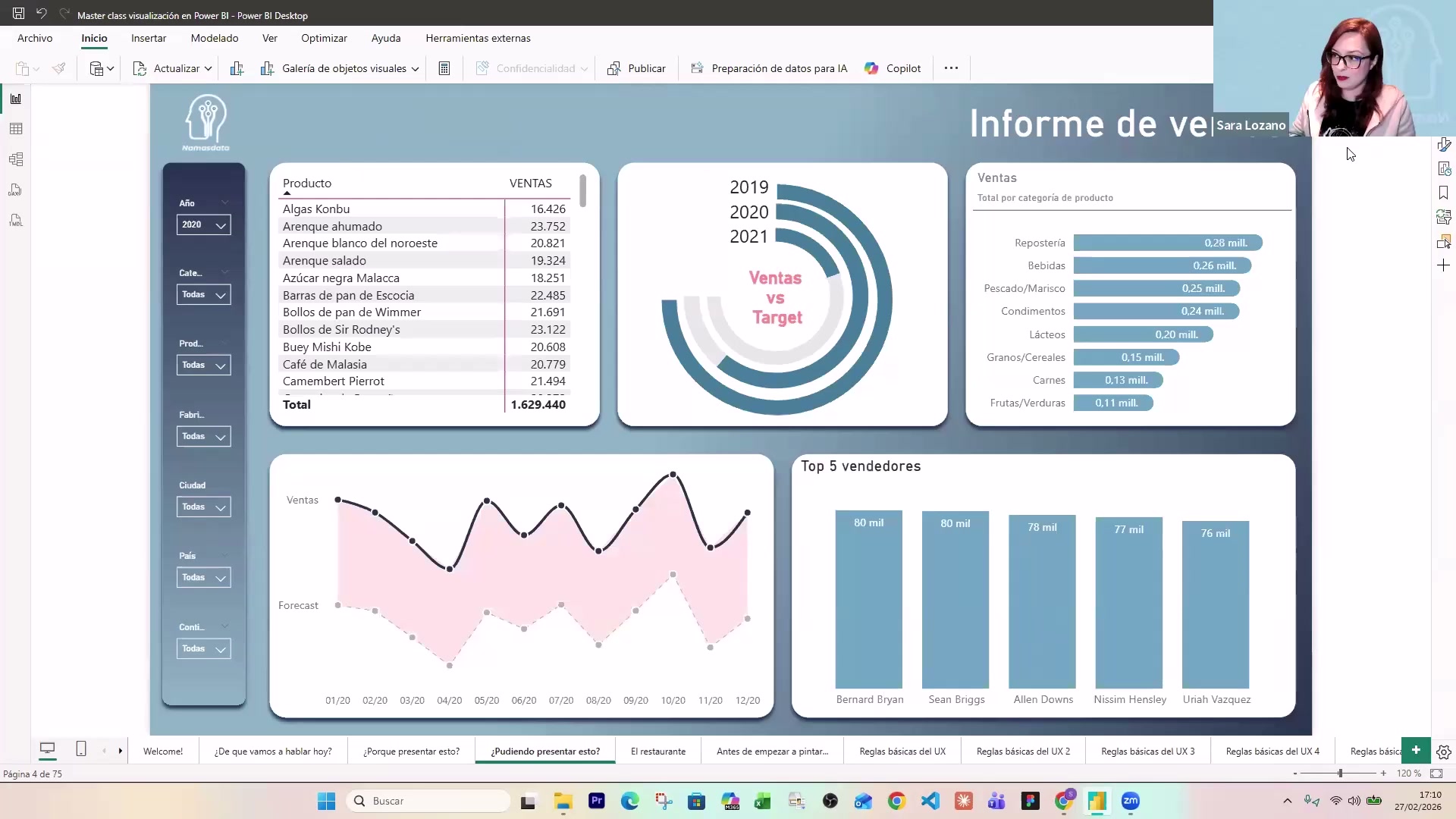

Power BI que late con el negocio

El siguiente paso fue conectar un modelo semántico a Eventhouse y levantar un informe en Power BI. No fue un despliegue visual masivo, sino algo mucho más potente: gráficos que cuentan una historia en vivo.

Un eje de tiempo con volúmenes de transacciones, líneas de precios que se actualizan, sectores comparados. Lo importante no fue la cantidad de gráficos, sino su pertinencia. En informes tradicionales, la discusión suele ser “qué pasó ayer”. En informes conectados a datos vivos, la conversación cambia a “qué está pasando ahora mismo”. Y eso, para un negocio, es oro.

Notebooks: laboratorio sin romper la producción

En paralelo, abrimos un Notebook. No como sustituto del Event Stream, sino como un espacio de ensayo. Aquí pudimos muestrear datos, transformarlos en dataframes y probar cálculos ligeros, incluso esbozar algoritmos de machine learning.

El enfoque fue realista: usar porciones representativas, medir tiempos y no dejar que el entusiasmo técnico nos haga olvidar la eficiencia. El Notebook es un laboratorio, no la fábrica. Te permite experimentar sin comprometer la estabilidad de lo que ya fluye.

Automatización con Activator: reaccionar al instante

Una de las novedades más potentes fue el uso de Activator. Con él configuramos reglas y disparadores que reaccionan a condiciones concretas en el flujo.

Si un símbolo bursátil baja de cierto umbral, se envía un correo. Si un evento se produce, se dispara un pipeline. Si un volumen se dispara, se lanza un aviso en Teams. El principio es claro: que las máquinas reaccionen a lo que saben medir, y que las personas se concentren en decidir qué hacer con esa información.

Seguridad: mínimo privilegio, máxima tranquilidad

Ningún sistema de tiempo real puede sostenerse sin control de accesos. Revisamos cómo aplicar el principio de mínimo privilegio en Fabric: dar a cada persona el nivel justo de acceso que necesita, ni más ni menos.

Esto se aplica tanto a áreas de trabajo como a artefactos individuales. Y la práctica lo demuestra: un permiso excesivo en streaming no solo expone datos, también multiplica el riesgo de errores en caliente. Aquí, más que en batch, el tiempo apremia.

Supervisión y gobierno: ver y certificar

La segunda capa es la supervisión. Fabric ofrece un centro de monitoreo que permite ver qué ocurre en cada área de trabajo: cargas, tiempos, errores, actividad de usuarios. No es solo un panel decorativo, es la única forma de detectar a tiempo cuellos de botella o mal uso de recursos.

La tercera capa es el gobierno. Aquí entran conceptos como la certificación de contenido. En organizaciones grandes, donde conviven múltiples informes y modelos, etiquetar qué artefactos son confiables evita duplicidades y discusiones interminables sobre cuál es la “verdad oficial”. La certificación convierte el caos en un marco común.

DevOps: trazabilidad como seguro de continuidad

Finalmente, exploramos la integración de Fabric con repositorios como GitHub. Puede sonar accesorio, pero no lo es. En entornos de datos en tiempo real, los cambios son constantes. Si no versionas y documentas, pierdes trazabilidad. Y sin trazabilidad, pierdes confianza en el sistema.

La integración con repositorios no es un capricho, es el seguro de continuidad que permite que un equipo siga construyendo sin miedo a romper lo que ya funciona.

Qué significa todo esto para ti

Si cierro los ojos y resumo lo aprendido, me quedo con esta idea: Fabric en tiempo real es una conversación continua con tus datos.

En batch, tú preguntas y esperas la respuesta. En streaming, los datos también te hablan. Tu trabajo es preparar el sistema para escucharlos con criterio, reaccionar a lo que importa y registrar lo que haces para que todo el equipo pueda seguir la conversación.

Esto no es solo teoría. Tiene aplicaciones inmediatas en operaciones, ventas, soporte o cualquier área donde el tiempo importa tanto como el dato. Un pipeline que escucha, un informe que late, una alerta que llega a tiempo: esa es la diferencia entre reaccionar a lo ocurrido y anticipar lo que viene.

Elige tu camino hacia la arquitectura de datos moderna

En NamasData estamos convencidos de que dominar esta arquitectura es lo que diferencia a un profesional que solo “hace informes” de aquel que transforma decisiones en el momento en que ocurren.

Si quieres dar ese salto, tienes dos caminos claros:

- Explorar el curso oficial de certificación PL-300, donde aprenderás a manejar Power BI con la solidez que te abre puertas en el mercado: www.cursopl300.com

- O dar el paso hacia Microsoft Fabric, la plataforma que integra todas las piezas para que tu carrera no se quede en los informes, sino que abrace la arquitectura de datos completa: www.dominafabric.com

Ambas rutas forman parte de la visión de NamasData: acompañarte desde tus primeros pasos hasta el dominio de arquitecturas modernas de datos.

Porque lo que te hace crecer no es acumular más hojas de Excel ni dashboards desconectados. Lo que realmente marca la diferencia es comprender cómo fluye el dato, cómo gobernarlo y cómo traducirlo en decisiones que importan.

Te invito a dar ese paso. Elige tu ruta y empieza hoy.

Para más sobre Fabric puedes leer aquí: https://blog.alexayala.es/category/fabric/

Deja un comentario