Este artículo resume parte de una clase real del curso de Microsoft Fabric impartido por Walter Calcagno Lucares en NamasData , arquitecto de datos y MVP de Microsoft. Todo el contenido que estás leyendo está extraído directamente de esa sesión formativa.

¿Te encuentras a menudo navegando en un mar de datos, donde la información vital parece oculta entre hojas de cálculo infinitas y sistemas desconectados? Si eres un analista de datos o trabajas con ellos, es probable que esta situación te resulte familiar: múltiples fuentes, formatos dispares y la constante presión por extraer valor antes de que el volumen o la velocidad te superen. Herramientas como Excel y Power BI son, sin duda, pilares en tu día a día, pero ¿qué sucede cuando la escala de los datos o la complejidad de las integraciones exceden sus capacidades?

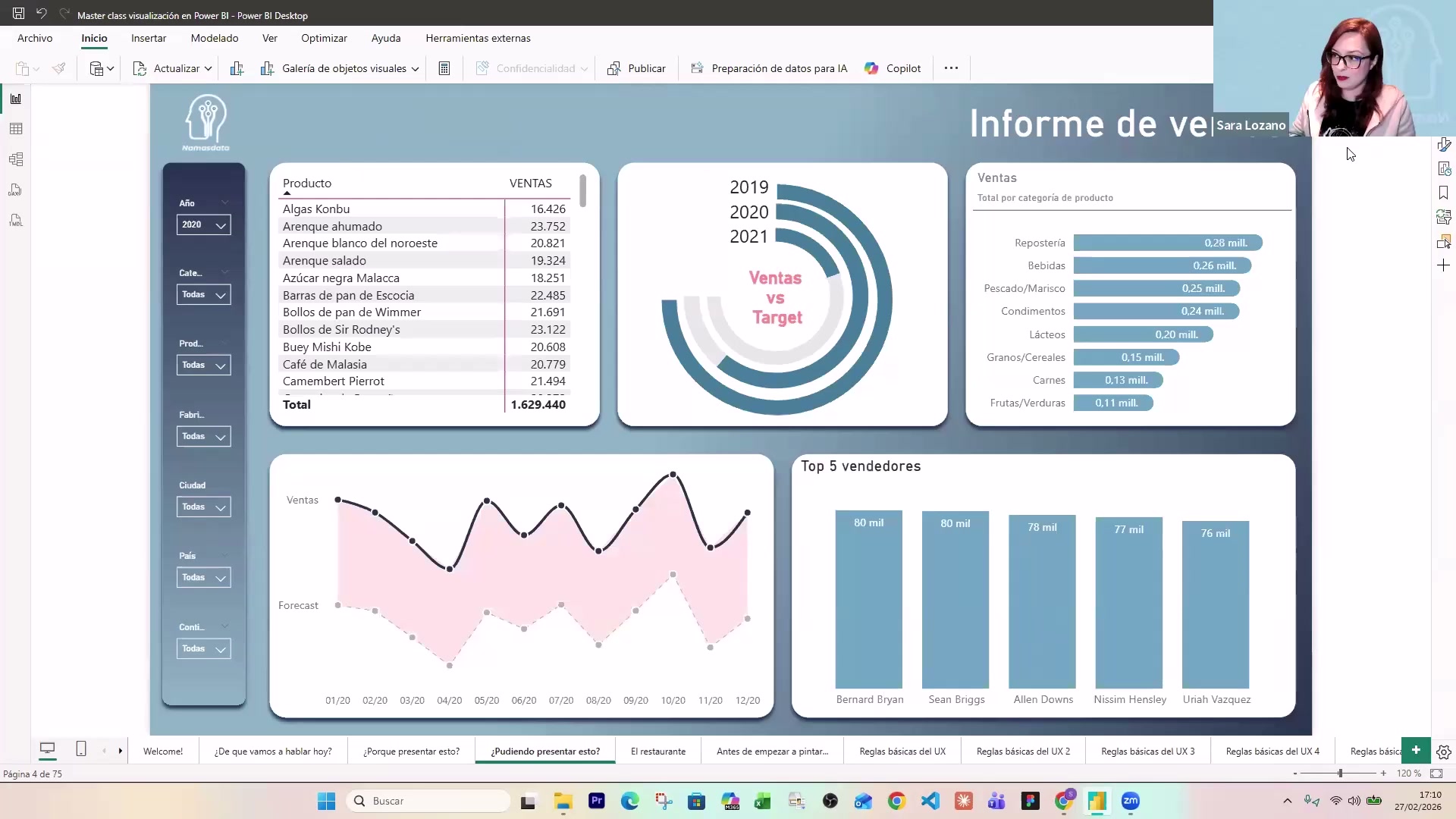

Detrás de cada informe y dashboard que visualizas en Power BI, existe un universo de datos en constante movimiento: desde su origen, pasando por su almacenamiento, hasta su transformación. Microsoft Fabric no llega para reemplazar tus herramientas actuales, sino para integrarse con ellas y potenciar ese «mundo oculto» de los datos. Es una suite de herramientas diseñada para gestionar de manera integral el ciclo de vida completo de la información, llevando la ingeniería de datos a un nivel superior.

La ingeniería de datos actúa como el puente esencial entre los sistemas operacionales de TI y el ámbito de la analítica. ¿Alguna vez has solicitado acceso directo a una base de datos de producción y te has encontrado con una negativa rotunda? La razón es simple: los sistemas operacionales están diseñados para la continuidad del negocio, no para el análisis, y cualquier intervención directa podría comprometer su estabilidad. Es aquí donde el ingeniero de datos se vuelve indispensable: su misión es extraer los datos de forma segura y eficiente, transformarlos y almacenarlos en un repositorio analítico, liberando a los equipos de TI y permitiendo a los analistas trabajar con la información de forma estructurada y sin riesgos.

El desafío del Big Data: Volumen, Velocidad y Variedad

Cuando se habla de Big Data, no se trata solo de tener una gran cantidad de información. El concepto se define por tres características fundamentales, conocidas como las «3 V»: volumen, velocidad y variedad.

- Volumen: Una organización se enfrenta a un problema de Big Data cuando su capacidad de procesamiento actual resulta insuficiente para manejar la cantidad de datos que recibe. No existe un umbral fijo de terabytes que defina el Big Data; la clave radica en la limitación de tus herramientas. Si tus sistemas se ralentizan, colapsan o no pueden procesar la información a tiempo, estás en un escenario de alto volumen. Esto implica la necesidad de escalar tu capacidad de procesamiento, ya sea vertical u horizontalmente.

- Velocidad: Este factor se refiere a la rapidez con la que los datos son generados y deben ser procesados. Pensemos en un sensor de GPS que envía miles de mensajes por segundo: aunque el volumen de cada mensaje sea pequeño, la alta frecuencia de llegada de datos (streaming) representa un desafío de velocidad. Procesar esta información en el momento oportuno requiere herramientas específicas que puedan manejar flujos continuos de datos, incluso si el volumen total no es masivo.

- Variedad: La diversidad de formatos y orígenes de los datos es otro gran obstáculo. Los datos pueden llegar en formatos estructurados (como tablas SQL), semi-estructurados (como JSON, XML con etiquetas que permiten una interpretación posterior) o no estructurados (como imágenes, audio, video). Integrar y analizar esta amalgama de tipos de datos es complejo y exige soluciones versátiles. Microsoft Fabric está diseñado para gestionar datos en cualquier formato y a cualquier escala, facilitando la unificación de la información.

La realidad es que, en la actualidad, cada vez más pequeñas y medianas organizaciones se enfrentan a situaciones de Big Data sin contar con los recursos o las herramientas adecuadas para analizarlos. Esto representa una pérdida significativa de oportunidades para la toma de decisiones. Fabric ofrece una solución asequible, permitiendo a las empresas trabajar con Big Data sin la necesidad de una infraestructura propia de alto costo.

La evolución de la arquitectura de datos: Del Data Warehouse a Lakehouse

La analítica de datos ha evolucionado significativamente a lo largo de las décadas. En sus inicios, el Business Intelligence se apoyaba principalmente en los Data Warehouses. Estos sistemas estaban optimizados para almacenar datos relacionales y estructurados, permitiendo consultas SQL rápidas y eficientes para responder a preguntas sobre el pasado: «¿qué ocurrió?» (analítica descriptiva) y «¿por qué ocurrió?» (analítica diagnóstica).

Sin embargo, con la explosión de los datos no estructurados y la creciente necesidad de analíticas más avanzadas —como la predictiva («¿qué va a ocurrir?») y la prescriptiva («¿cómo hacemos que esto ocurra?»)—, los Data Warehouses comenzaron a mostrar sus limitaciones. Fue entonces, alrededor de 2010, cuando surgió el concepto de Data Lake.

Los Data Lakes son repositorios diseñados para almacenar grandes volúmenes de datos en su formato original, sin necesidad de una estructura predefinida. Esto los convierte en un archivo histórico invaluable, ideal para datos no estructurados. Para gestionar la complejidad de estos datos, se popularizó la arquitectura de capas, también conocida como arquitectura medallón (aunque el término puede ser restrictivo, ya que sugiere solo tres capas, cuando en realidad pueden ser más).

Esta arquitectura organiza el Data Lake en diferentes niveles de refinamiento:

- Capa Cruda (Bronze/Raw/Landing): Aquí los datos se almacenan tal cual llegan de sus fuentes, sin ninguna transformación, limpieza o deduplicación. Su propósito principal es mantener un registro histórico inalterado de la información.

- Capa de Servicios (Silver/Trusted): En esta etapa, los datos crudos son sometidos a procesos de limpieza, estandarización y transformación. Se eliminan duplicados, se corrigen inconsistencias y se estructuran en formatos tabulares, dejándolos listos para un análisis más confiable.

- Capa de Consumo (Gold/Curated): Esta es la capa más refinada, donde los datos se enriquecen y se preparan para usos específicos y de alto valor. Aquí se pueden aplicar modelos de Machine Learning, preparar datos para inteligencia artificial generativa, o crear conjuntos de datos optimizados para dashboards y reportes.

Es crucial entender que el número de capas no es fijo. Una organización puede implementar dos, tres, cuatro o más capas, dependiendo de sus necesidades analíticas y la complejidad de sus datos. La flexibilidad es clave.

El siguiente hito en esta evolución es el Lakehouse, un concepto que busca combinar las ventajas del Data Lake (gran volumen, bajo costo, flexibilidad para datos no estructurados) con las del Data Warehouse (indexación, alto rendimiento en consultas y propiedades ACID: atomicidad, consistencia, aislamiento y durabilidad). Las propiedades ACID, tradicionalmente asociadas a las bases de datos relacionales, garantizan la fiabilidad de las transacciones. El estándar Delta Lake, desarrollado por Databricks, permitió que los Data Lakes adquirieran estas propiedades, abriendo el camino para las soluciones Lakehouse.

Microsoft Fabric se apoya firmemente en esta arquitectura Lakehouse. Utiliza formatos de archivo columnares como Parquet (a menudo denominado «Delta Parquet» por razones comerciales), que optimizan la lectura de grandes volúmenes de datos y permiten una gestión avanzada de metadatos. Esta capacidad de manejar metadatos es fundamental para la indexación y la integración con herramientas de inteligencia artificial.

Arquitecturas de Data Warehouse: Inmon vs. Kimball

Dentro de la disciplina del Data Warehousing, han coexistido históricamente dos aproximaciones principales para el diseño y la implementación:

- Enfoque de Bill Inmon (Top-Down):

- Enfoque de Ralph Kimball (Bottom-Up):

¿Cuál utiliza Microsoft Fabric? Por defecto, Microsoft Fabric sigue el enfoque Kimball para la creación de sus Data Warehouses y Lakehouses. Esto significa que la prioridad está en la facilidad de modelado dimensional para el análisis. Sin embargo, esto no invalida el enfoque Inmon. De hecho, la capacidad de Fabric para gestionar metadatos de forma avanzada está permitiendo que el enfoque Inmon recupere fuerza, especialmente para la implementación de soluciones de inteligencia artificial que requieren datos muy bien catalogados e indexados de forma vectorial. Es común encontrar organizaciones que utilizan una combinación de ambos enfoques para satisfacer distintas necesidades.

Microsoft Fabric: Una solución integral y asequible

Microsoft Fabric se distingue por ser una solución Software as a Service (SaaS). ¿Qué significa esto para ti? A diferencia de una Plataforma como Servicio (PaaS), donde el usuario tiene una mayor responsabilidad en la configuración y gestión de la infraestructura subyacente, en un SaaS, el proveedor (Microsoft) asume gran parte de esa carga. Esto se traduce en:

- Menor complejidad de configuración: Tendrás menos elementos que configurar, lo que reduce la curva de aprendizaje y la probabilidad de errores.

- Mayor responsabilidad del proveedor: Si algo falla a nivel de infraestructura, es Microsoft quien debe resolverlo, no tú.

- Mayor accesibilidad: Al no requerir una inversión significativa en infraestructura o personal especializado para su gestión, Fabric se vuelve accesible para organizaciones de todos los tamaños, democratizando el acceso a capacidades de Big Data.

Dentro de Fabric, te encontrarás con un conjunto de artefactos clave diseñados para cada etapa del ciclo de vida del dato:

- Lakehouse: Es el corazón de tu repositorio de datos en Fabric. Combina la flexibilidad de un Data Lake (para almacenar archivos de cualquier tipo, organizados en carpetas) con la capacidad de un Data Warehouse (para exponer esos datos como tablas, optimizadas para consultas SQL). No te preocupes por el espacio; su capacidad de almacenamiento es prácticamente ilimitada y escalable.

- Pipelines (Canalizaciones de datos): Estas herramientas son ideales para la ingesta y orquestación de datos. Permiten mover grandes volúmenes de información entre diferentes fuentes y destinos de manera eficiente y programada. Son excelentes para copiar datos, pero para transformaciones complejas, se recomiendan otras herramientas.

- Dataflows Gen2 (Flujos de datos de segunda generación): Si ya estás familiarizado con Power Query, te sentirás cómodo aquí. Los Dataflows Gen2 permiten realizar transformaciones de datos de forma visual, utilizando el lenguaje M. Son perfectos para operaciones de limpieza y modelado de datos de complejidad intermedia.

- Notebooks: Esta es la herramienta estrella para la transformación y el análisis avanzado de datos. Los Notebooks te permiten escribir código en lenguajes como PySpark (Python con Spark), Scala, Spark SQL y R. Aprovechan la potencia de Spark para el procesamiento distribuido de grandes volúmenes de datos, sin que tengas que preocuparte por la configuración de los clústeres subyacentes. Además, podrás implementar modelos de Machine Learning directamente en tus Notebooks para tareas como la proyección de ventas o la detección de anomalías.

- Eventstreams: Diseñados para la ingesta y el procesamiento de datos en streaming. Permiten capturar y canalizar mensajes continuos (como los de sensores IoT) para análisis en «próximo tiempo real», es decir, con una latencia mínima que permite tomar decisiones oportunas.

Fabric también facilita la integración con tus sistemas existentes a través de shortcuts (atajos). Si ya tienes datos almacenados en otras nubes (como Azure Blob Storage, Google BigQuery o Amazon S3) en formatos compatibles con Delta Lake/Parquet, puedes crear un atajo en Fabric que te permite acceder a esos datos sin necesidad de duplicarlos. Esto optimiza el uso del almacenamiento y asegura que siempre trabajes con la información más actualizada. Es importante destacar que estos atajos se conectan a entornos analíticos, nunca a sistemas de producción transaccionales, evitando así la saturación de tus sistemas operativos.

El valor diferencial de aprender Fabric ahora

Microsoft Fabric se encuentra en una etapa temprana de adopción, lo que representa una oportunidad estratégica para los profesionales de datos. Dada la posición dominante de Microsoft en el mercado empresarial (con una alta penetración en la industria) y el liderazgo de Power BI en el Business Intelligence, la demanda de especialistas en Fabric está destinada a crecer exponencialmente en los próximos 5 a 10 años.

Dominar Fabric no solo te equipa con las herramientas más avanzadas para la ingeniería de datos, sino que te introduce a un ecosistema que, aunque potente, es sorprendentemente amigable para quienes no provienen de un background de programación pura. Si bien te sumergirás en lenguajes como PySpark, el curso está diseñado para proporcionarte las bases necesarias y, lo que es más importante, las estrategias para abordar el código de manera efectiva, incluso utilizando herramientas de inteligencia artificial para facilitar tu aprendizaje.

Este es el momento de dar el salto, de pasar de ser un analista que consume datos a un ingeniero que los moldea y los prepara para el futuro.

¿Quieres aprender esto en serio, con guía práctica y entorno real? Apúntate al curso en www.dominafabric.com

Deja un comentario